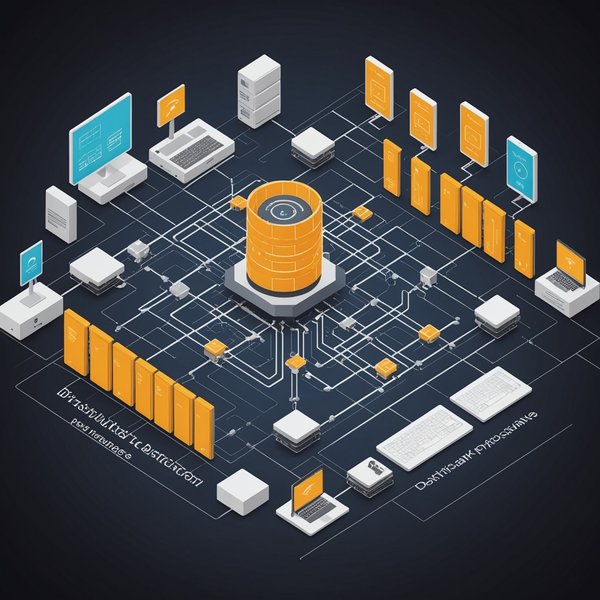

L’ère du big data a transformé la manière dont nous collectons, analysons et utilisons les informations. Dans ce contexte, une architecture de calcul distribué est devenue essentielle pour traiter efficacement de vastes volumes de données. Parmi les outils de choix pour cette tâche, Apache Spark se distingue par sa capacité à gérer et analyser rapidement de grandes quantités de données. Ce guide vous accompagnera dans le déploiement d’une architecture de calcul distribué avec Apache Spark, afin que vous puissiez exploiter pleinement le potentiel du big data.

Pourquoi choisir Apache Spark pour le calcul distribué ?

Apache Spark est une plateforme de calcul distribué open-source, conçue pour le traitement rapide des données. Contrairement à Hadoop, Spark utilise la mémoire vive pour traiter les données, ce qui le rend bien plus rapide. Mais pourquoi choisir Spark parmi tant d’autres solutions ?

Performances exceptionnelles et flexibilité

Spark est réputé pour ses performances élevées. Il peut traiter des volumes de données massifs en un temps record, grâce à son modèle de calcul en mémoire. Cette rapidité est particulièrement précieuse lorsque vous travaillez avec des datasets volumineux et complexes. De plus, Spark est flexible : il supporte plusieurs langages de programmation, y compris Java, Scala, Python et R, ce qui permet de l’intégrer facilement à divers environnements de développement.

Écosystème riche et support de multiples API

Spark ne se limite pas au traitement des données. Il propose un écosystème riche comprenant des bibliothèques pour le machine learning (MLlib), le traitement du graph (GraphX), le streaming (Spark Streaming) et la manipulation de données structurées (Spark SQL). Cette diversité permet aux entreprises d’utiliser un seul framework pour différentes tâches de calcul, simplifiant ainsi le développement et la maintenance des applications.

Facilité de déploiement et scalabilité

Déployer Spark est relativement simple. Que vous utilisiez un cluster local, un cluster Hadoop, ou des services cloud tels qu’AWS ou Google Cloud, Spark s’intègre facilement. De plus, sa capacité à évoluer en fonction des besoins en fait une solution idéale pour les entreprises de toutes tailles.

Les prérequis pour déployer Apache Spark

Avant de vous lancer dans le déploiement d’Apache Spark, plusieurs éléments doivent être pris en compte. Un environnement approprié et bien configuré est crucial pour garantir des performances optimales et une intégration sans heurts.

Configuration matérielle et logicielle

Pour commencer, assurez-vous de disposer d’une infrastructure adéquate. Un cluster Spark typique comprend plusieurs nœuds, chacun ayant une certaine quantité de CPU et de RAM. Pour une installation de base, un cluster de trois à cinq nœuds est souvent suffisant. Cependant, plus votre volume de données est élevé, plus vous aurez besoin de nœuds.

Installation de Java et Spark

Spark nécessite une installation Java. La version recommandée est Java 8, bien que Spark soit compatible avec Java 11. Une fois Java en place, vous pouvez télécharger Spark depuis le site officiel, puis l’extraire sur chaque nœud de votre cluster. Veillez à configurer les variables d’environnement JAVA_HOME et SPARK_HOME.

Configuration réseau et sécurité

Un réseau fiable est essentiel pour un cluster Spark performant. Configurez votre réseau de manière à minimiser la latence entre les nœuds. En matière de sécurité, utilisez des protocoles comme SSH pour l’authentification et le chiffrement des communications entre nœuds. Spark supporte également l’intégration avec des systèmes de gestion des identités et des accès, comme Kerberos.

Mise en place du cluster Spark

Le déploiement de Spark nécessite une configuration minutieuse. Cette section vous guidera à travers les étapes nécessaires pour configurer et lancer votre cluster Spark.

Configuration des nœuds du cluster

Chaque nœud de votre cluster doit être configuré pour exécuter Spark. Cela implique l’installation de Spark sur chaque nœud et la configuration des fichiers de paramètres. Les principaux fichiers de configuration sont spark-env.sh, spark-defaults.conf et slaves. Le fichier spark-env.sh doit être adapté pour inclure les chemins d’accès aux répertoires Spark, Java, et les paramètres de la mémoire et du CPU.

Démarrage du cluster

Une fois les fichiers de configuration en place, vous pouvez démarrer le cluster Spark. Cela commence par le lancement du master node, qui coordonne les tâches entre les nœuds esclaves. Exécutez la commande start-master.sh sur le nœud maître pour démarrer le service. Ensuite, lancez les nœuds esclaves avec la commande start-slaves.sh. Vous pouvez vérifier l’état de votre cluster en accédant à l’interface web du maître, généralement à l’adresse http://master-node:8080.

Tests de performance et ajustements

Pour vous assurer que votre cluster fonctionne correctement, il est utile de réaliser des tests de performance. Exécutez des tâches de benchmark pour évaluer la vitesse de traitement et l’utilisation des ressources. Si des goulets d’étranglement sont identifiés, ajustez les paramètres de configuration en conséquence. Les principaux paramètres à surveiller sont la mémoire allouée aux exécuteurs, le nombre de partitions, et la taille des blocs de données.

Optimisation et bonnes pratiques pour Apache Spark

Un déploiement réussi de Spark nécessite plus que la simple configuration du cluster. Il est essentiel d’optimiser les performances et d’adopter des bonnes pratiques pour tirer le meilleur parti de votre infrastructure.

Gestion de la mémoire et des ressources

L’optimisation de l’utilisation de la mémoire est cruciale pour Spark. Répartissez judicieusement la mémoire entre les différentes tâches et étapes de traitement. Utilisez les paramètres spark.executor.memory et spark.driver.memory pour ajuster la mémoire allouée aux exécuteurs et au maître. En outre, l’usage de la mémoire cache pour stocker les datasets fréquemment utilisés peut considérablement améliorer les performances.

Partitionnement des données

Le partitionnement des données joue un rôle clé dans les performances de Spark. Divisez vos datasets en partitions plus petites pour paralléliser les tâches. Utilisez des transformations comme repartition et coalesce pour ajuster le nombre de partitions selon les besoins. Un bon partitionnement peut réduire la charge de travail sur chaque nœud et améliorer la vitesse de traitement.

Surveillance et optimisation continue

La surveillance continue est essentielle pour maintenir la performance de votre cluster. Utilisez des outils comme Ganglia ou Graphite pour surveiller les métriques clés, telles que l’utilisation de la mémoire, le temps de traitement des tâches, et le débit réseau. Analysez régulièrement ces métriques et ajustez les configurations en conséquence pour optimiser les performances.

Déployer une architecture de calcul distribué avec Apache Spark pour le traitement de big data est une étape cruciale pour toute organisation cherchant à tirer parti de ses données. Grâce à ses performances exceptionnelles, sa flexibilité et son écosystème riche, Spark permet de traiter de grandes quantités de données de manière rapide et efficace. En suivant les prérequis, les étapes de mise en place du cluster, et en adoptant des bonnes pratiques d’optimisation, vous serez en mesure de maximiser les performances de votre infrastructure.

En conclusion, Spark n’est pas seulement un outil puissant pour le traitement de données, mais également une plateforme versatile et extensible. Que vous soyez une petite entreprise ou une grande organisation, l’intégration de Spark dans votre architecture de données vous permettra d’exploiter pleinement le potentiel de vos données et de prendre des décisions éclairées. Alors, prêts à passer à la vitesse supérieure avec Apache Spark ?